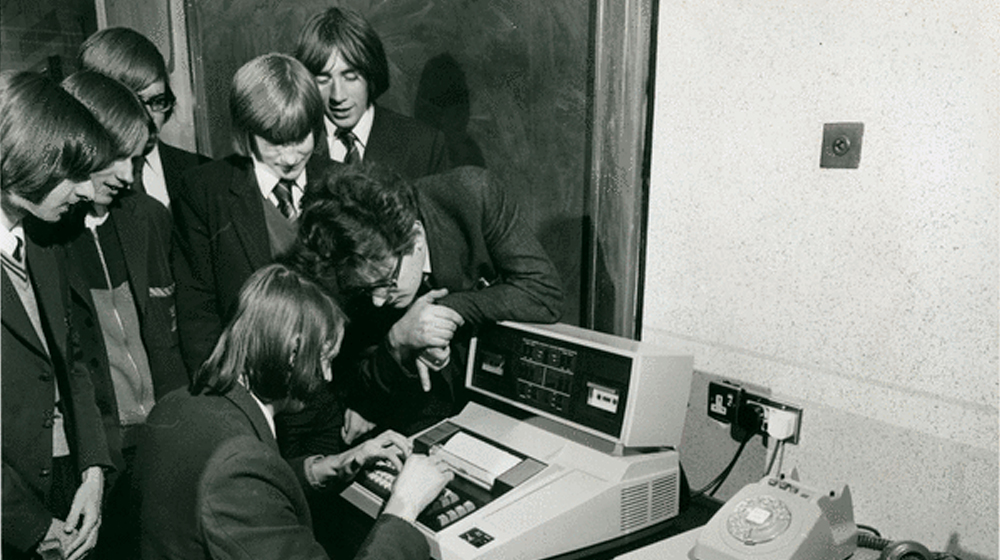

Estudiantes en el laboratorio de informática de la William Hulme Grammar School, c. 1974 | University of Salford, Manchester | CC-BY-NC-ND

En los últimos meses, se ha producido un giro en el papel público de los principales medios de comunicación, tradicionales y tecnológicos. Las grandes plataformas han iniciado una batalla contra la desinformación en distintos niveles que ha tenido su punto álgido en las elecciones estadounidenses. Las grandes cadenas de televisión y los grandes diarios norteamericanos han tomado conciencia de que vivimos en tiempos de posverdad, y las redes sociales han asumido su condición de editores de la información y, con ella, de la realidad. Ante este cambio de paradigma, cabe reflexionar sobre la frontera entre edición y censura, y preguntarse sobre quién debería recaer la regulación ética de la información.

El pasado 5 de noviembre, durante la demencial rueda de prensa de Donald Trump en la que denunció que le estaban robando las elecciones, ocurrió algo histórico: tres grandes cadenas de televisión (ABC, CBS y NBC) cortaron la retransmisión en directo. En otras palabras: se negaron a seguir difundiendo noticias falsas (las famosas fake news). El mismo día, Twitter y YouTube cancelaron la cuenta y el canal del polémico diseñador de teorías de la conspiración Steve Bannon, porque acababa de pedir en ellas que decapitaran al director del FBI y colgaran su cabeza. Durante las semanas anteriores, las principales redes sociales habían procedido de un modo similar: tanto Facebook como Twitter borraron contenidos de Trump y de cuentas de su campaña tras considerarlos fraudulentos o una incitación al odio.

Se trata de un giro muy importante en el papel público de las grandes plataformas. Durante el último año se las ha acusado, con argumentos sólidos, de haber cambiado el mundo para peor. Ya existen estudios serios que demuestran que Trump o Bolsonaro no hubieran llegado al poder sin ellas. Y han decidido actuar en consecuencia.

Si tienes cuenta de Twitter lo habrás notado: ahora ya no se puede retuitear un tuit que contenga un enlace, sino que aparece la opción de ir al artículo para leerlo primero o citarlo en un tuit propio. Es decir, ahora el retuit se hace en dos tiempos. Después de tantos años de likes y retuits automáticos, instintivos, casi animales, los ingenieros de Silicon Valley han puesto de moda el concepto de la «fricción». Aumentar la fricción en el diseño de interacción de los dispositivos y las redes sociales significa convertir lo que antes era un clic en dos o en tres. Esa dilatación quiere evitar que se compartan noticias de un modo compulsivo e invitar a quien lo hace a una mínima reflexión sobre qué está difundiendo.

Al mismo tiempo, esa fricción atenta contra el propio espíritu de las redes sociales durante sus quince años de existencia. En todo ese tiempo, lo que han hecho, precisamente, es ir limando todo aquello que no permitiera que el usuario navegara, surfeara, se deslizara por las superficies de sus interfaces con la mayor suavidad e inmediatez posible. El peso de la victoria de Trump, la culpa por la manipulación que favorecieron con esos mecanismos demasiado bien engrasados, han sido determinantes para el cambio radical en el marco de las elecciones de 2020. Una oportunidad para la reparación simbólica. Una prueba de fuego para ellas porque, como dijo Kevin Roose en The New York Times, han tenido que volverse peores herramientas y sistemas para hacer la democracia un poco mejor.

TikTok tiene su propio centro de seguridad para combatir la desinformación. Facebook ha creado un centro de verificación externo, al que pertenece –entre decenas de medios de todo el mundo que forman parte de la red International Fact-Checking– la web española maldita.es. Ya antes del verano, todas las grandes redes sociales habían tomado medidas para que circulara la información correcta sobre la COVID-19, en detrimento de la fraudulenta y conspiranoica. Las elecciones estadounidenses fueron la segunda fase de esa misma batalla contra la desinformación (ambas interconectadas, porque el propio Gobierno de los Estados Unidos contribuyó a difundir bulos sobre la pandemia). Facebook incluso aprobó un protocolo de interrupción de la viralidad.

Se trata de la actualización de estrategias que algunas plataformas han desarrollado durante los últimos años para reforzar el bien común y limpiar su imagen, como, por ejemplo, la respuesta ante emergencias de Facebook (cuando ocurre un terremoto o un atentado terrorista) o, en la misma línea, el Google Person Finder. Pero ya no aplicadas al mundo exterior, a las catástrofes naturales, sino a los desastres más sutiles y pixelados que han provocado las propias redes sociales (o personajes siniestros, como Dominic Cummings, el arquitecto del Brexit, o Steve Bannon, vicepresidente de Cambridge Analytica y asesor de Donald Trump, entre otras fechorías).

Durante las últimas elecciones, las grandes cadenas de televisión y los grandes diarios estadounidenses han tomado conciencia de que vivimos en tiempos de posverdad y de que las reglas tradicionales del periodismo han dejado de ser válidas. En el mundo previo a la presidencia de Trump, la televisión hubiera seguido retransmitiendo el delirio de un presidente. En el mundo que nos deja en herencia, en cambio, ya no van a hacerlo. Las propias redes sociales, que han sido las principales responsables de ese cambio de paradigma, han reaccionado con decisiones parecidas. Están borrando o etiquetando lo que dicen en sus plataformas ciertos líderes de opinión. De ese modo, han asumido su condición de editores de la información y, con ella, de la realidad. Editar significa controlar, alterar, dirigir, prescribir y, a veces, también, censurar. ¿Es censura lo que están haciendo los principales medios de comunicación, tradicionales y tecnológicos, de los Estados Unidos?

La iniciativa en España del gobierno de Pedro Sánchez para crear formas de control de la información y la desinformación desde el Gobierno ha sido calificada por los expertos en derecho como una probable causa de inestabilidad jurídica. Su razón de ser es el nuevo contexto internacional, la imitación de los partidos de ultraderecha de todo el mundo de las estrategias de Bannon –entre ellos, Vox– y la comprobada injerencia de gobiernos extranjeros en las elecciones democráticas, que de ese modo han dejado de ser enteramente soberanas. Más allá de las críticas a la libertad de prensa y a la libertad de expresión (hay que recordar que en España sigue vigente la llamada «ley mordaza»), merece la pena reflexionar sobre si hay que delegar en los grandes medios de comunicación y en las grandes plataformas la regulación ética de la información o si son las entidades públicas quienes deben asumir ese papel. ¿Tiene sentido que Facebook o Twitter decidan qué es o no verdadero? ¿Deberían hacerlo, en su lugar, la Unión Europea o la ONU? Como se preguntaron Juvenal y Alan Moore: ¿Quién vigila a los vigilantes?

Deja un comentario