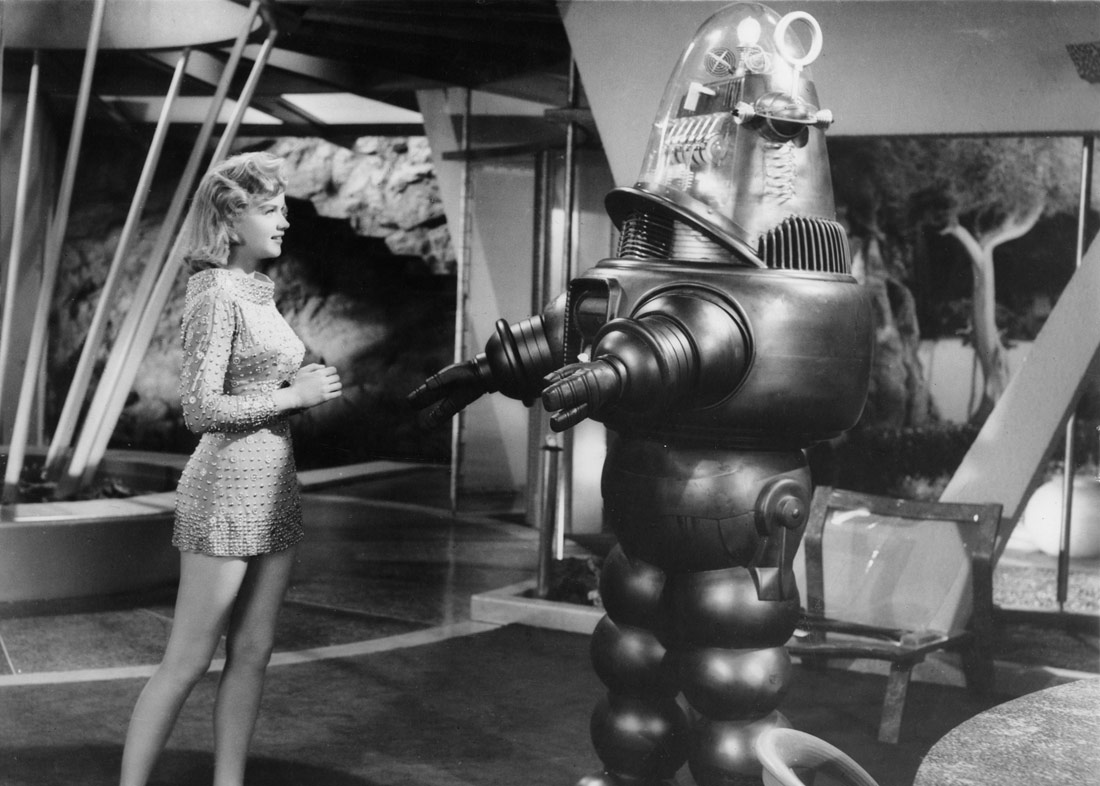

Forbidden Planet, 1959 | Digitalt Museum. Tekniska museet | Dominio público

Nos encontramos en un momento de singularidad esencial en la historia de la humanidad. Según esta tesis, el acelerado progreso tecnológico nos está acercando a un punto de no retorno, en el que la inteligencia computacional alcanzará tal nivel de complejidad que será capaz de mejorarse a sí misma. Una vez la tecnología ingrese en esta dinámica de autoaprendizaje, la dependencia humana quedará superada, abriendo un nuevo campo de autonomía y eficiencia que conducirá inevitablemente hacia un progreso de la inteligencia artificial sin precedentes. Publicamos, por cortesía de Ariel, un avance del nuevo libro de José Ignacio Latorre, Ética para máquinas, en el que propone una reflexión sobre la ética necesaria para la nueva sociedad que se avecina.

Los quehaceres humanos, tal como los conocemos hoy en día, no podrán seguir inalterados.

John von Neumann

Superados

John von Neumann fue tal vez una de las primeras personas en vislumbrar la enorme potencia de cálculo que un ordenador podría llegar a tener. Tras su muerte, su colega Stanisław Ulam citó unas palabras suyas de la siguiente forma:

El continuo y acelerado progreso de la tecnología y los cambios en la forma de vida de los humanos muestran signos de aproximarse a una especie de singularidad esencial en la historia de la especie.

Lúcida reflexión, atribuida a von Neumann en 1950. Más tarde, Vernor Vinge escribió un ensayo titulado Technological Singularity («Singularidad tecnológica», 1993), en el que propone la superación de la mente humana por máquinas equipadas con inteligencia artificial. Esta idea fue retomada con inusitado vigor por Ray Kurzweil en su libro The Singularity Is Near: When Humans Transcend Biology («La Singularidad está cerca: cuando los humanos trascendamos la biología», 2005). El título es autoexplicativo. Según Kurzweil, los humanos dejarán atrás su soporte biológico y pasarán su inteligencia a las máquinas. La idea de singularidad también dio lugar a la llamada Singularity University, institución fundada en 2008 y creada por una serie de personas relevantes en el mundo de la tecnología avanzada. Su lema es inequívoco: «Preparando a la humanidad para un cambio acelerado de tecnología.»

El argumento esencial asociado a la Singularidad es de una lógica aplastante. Si construimos inteligencias artificiales cada vez más potentes y autónomas, llegará un instante en el que un algoritmo podrá mejorarse a sí mismo. Una vez mejorado, el nuevo algoritmo será aún más potente y, en consecuencia, capaz de volver a mejorarse a sí mismo. Se establece una cadena que se retroalimenta. Cada inteligencia artificial diseñará a la siguiente, que será aún mejor que ella misma. Ese proceso iterativo seguirá avanzando de forma imparable hacia una inteligencia brutal. Habremos alcanzado la Singularidad.

Podemos intentar desarrollar una cierta intuición de cómo llegaremos a la Singularidad. Imaginemos que la inteligencia artificial avanza gracias a comprender mejor la sofisticada arquitectura de una gigantesca red neuronal. El problema de diseñar los circuitos neuronales artificiales reviste una dificultad extrema. En un primer momento, estamos utilizando métodos controlados por humanos para explorar mejores arquitecturas neuronales. Pero está llegando el instante en el que la exploración de nuevas arquitecturas es diseñada por una propia red neuronal artificial mejorada. Ella se podrá autoanalizar y mejorar. Será como un buen estudiante que empieza a aprender solo y llega mucho más allá que sus profesores.

Tomemos este último ejemplo de forma seria. Un buen estudiante, adolescente brillante, empieza a aprender matemáticas con sus buenos profesores. Estos le enseñan a aprender. La potencia intelectual del estudiante es superior a la de sus profesores de instituto. Avanza a la universidad. Ahí su cerebro sigue mejorando. Deja atrás a los catedráticos más sabios. Visita las mejores universidades del planeta. Trabaja muy duro y sigue dejando atrás a los mejores investigadores de su tiempo. Ya está solo. Sigue avanzando por retroalimentación propia. Aprende a aprender por sí mismo. Intuye, establece sus líneas de investigación. Cada vez es mejor y mejor.

Una inteligencia artificial avanzada operaría de la misma forma que un muy buen estudiante. Pero, no lo olvidemos, esta máquina no sufrirá los límites que impone la biología. Los circuitos integrados, los ordenadores cuánticos y futuros desarrollos que hoy ni siquiera vislumbramos llenarán de vértigo el progreso de la inteligencia artificial.

Es importante enfatizar el punto crucial del cambio de sustrato entre inteligencia humana e inteligencia artificial. La Singularidad precisa de sobrepasar los límites impuestos por el tejido nervioso, las células de la glía, los nutrientes que llegan por la sangre, el tamaño pequeño del cerebro, la muerte de sus partes. Una inteligencia artificial basada en sustratos de silicio tiene capacidad de crecer mucho más allá del cerebro humano y de no perecer.

¿Pueden imaginar una máquina inteligente e imperecedera que se cree a sí misma? ¿Qué tamaño tendría? ¿Cubriría la tierra? ¿Sería única o repartida? ¿Sería violenta? ¿Acabaría con los humanos?

Inteligencia superior única

Imaginemos que hemos llegado a la Singularidad y que hemos creado una inteligencia notablemente superior a la nuestra. ¿Existirá una única inteligencia artificial avanzada, o se darán varias?

Podemos defender las dos posibilidades.

Empecemos por argumentar que, si se llega a la Singularidad, la inteligencia superior creada será única. Una inteligencia suprema debería ser pacífica, nada hostil, dado que no hallaría beneficio en la violencia. La inteligencia artificial podrá sustentarse sin esfuerzo, crecer sin obstáculo. Podrá proporcionarse todo lo que necesite de forma eficiente. Será una magnífica gestora de su sustrato físico. Si hubiera otra inteligencia artificial, ambas optarían por unirse y generar una inteligencia todavía más potente. Así lo hacemos los humanos cuando nos adentramos en tareas superiores como el estudio de la ciencia pura. Los matemáticos, los físicos, los biólogos, todos los científicos que buscan el saber básico colaboran entre sí. Es cierto que el sistema académico está creado para fomentar la competición. Pero es mucho más cierto que todas las personas que se enfrentan a problemas científicos difíciles saben que estos les superan individualmente y que solo avanzan cuando juntan sus fuerzas. Si una inteligencia superior se relaciona con otra, ambas se unirán.

Existe un ejemplo del mundo de la economía que ilustra la creación de un ente todopoderoso único. Tomemos el ejemplo simplificado de los negocios. Una forma de modelar una transacción económica entre dos personas es la siguiente. Ambas ponen una cantidad de dinero en un bote común. Se hace un sorteo y una se lleva el botín y la otra lo pierde todo. Está claro que esta forma de simular una transacción está alejada de la realidad. Pero sí es cierto que en muchas operaciones uno gana y el otro pierde. La idea aquí es exagerar esta situación y ver qué consecuencias tiene. Para averiguar el resultado, podemos crear un programa donde autómatas celulares operen según esta regla. El algoritmo creará entidades virtuales que aleatoriamente se asociarán, harán una operación por una cierta cantidad de dinero y alguien ganará y alguien perderá. Si dejamos ese universo virtual evolucionar haciendo transacciones entre sus individuos, poco a poco veremos que unos pocos seres se hacen más y más ricos y otros se empobrecen. El resultado final es que una persona lo tiene todo y los demás nada. Es fácil entender el porqué de este límite. En cada transacción hay una probabilidad no nula de perder el dinero. Luego hay una probabilidad no nula de que un individuo concatene malos negocios y lo pierda absolutamente todo. Ese individuo queda fuera del juego. Hay una persona menos. El mismo argumento se repite y cada vez una persona desaparece. Al final solo queda uno, que lo tiene todo. Nuestro mundo real no está tan lejos de este juego. Unas pocas personas poseen la riqueza de todos los humanos. La realidad compensa este fenómeno estableciendo reglas para que los más pobres puedan subir peldaños económicos. Por ejemplo, los créditos bancarios permiten a un individuo tomar prestado dinero y volver a entrar en el juego, las herencias aportan dinero ganado por familiares o la lotería, que es dinero llovido del cielo.

Pero a continuación podemos argumentar justo lo contrario: de existir inteligencias superiores a la humana, estas serían muchas, no una única. La idea central es que es beneficioso tener diferentes aproximaciones al mismo problema. Muchas personas inteligentes diferentes hacen que un campo avance más rápido que una sola persona también muy inteligente. En biología, es beneficioso para una especie mantener una diversidad genética amplia. Si todo se apuesta al individuo mejor dotado, la especie pierde la capacidad de corrección frente a un cambio crítico de las condiciones externas. Es bueno tener individuos con material genético muy diverso, porque sus genes pueden ser enormemente útiles en el futuro. Una inteligencia artificial avanzada debería mantener otras inteligencias independientes a ella. Podría existir un conjunto de inteligencias avanzadas de diferente nivel intelectual y orientadas a objetivos sutilmente diferentes, basadas en algoritmos independientes.

Nos dice Jean-Jacques Rousseau en su Émile (1762) que «es la debilidad del hombre lo que lo hace sociable». Argumenta que:

Todo apego es un signo de insuficiencia: si cada uno de nosotros no tuviese ninguna necesidad de los demás, ni siquiera pensaría en unirse a ellos.

Una inteligencia artificial fuerte sería, según Rousseau, solitaria, tal vez no única, pero sin amigos.

Una inteligencia artificial avanzada única, en inglés, recibe el nombre de singleton. Si el futuro de la inteligencia artificial extrema es un singleton, creo que se va a aburrir soberanamente al estar tan solo.

Hernando Urrego | 16 septiembre 2020

Se me ocurre pensar por un momento que si, los algoritmos con que se programan a una máquina, establecen límites comportamentales, en relación con una área del conocimiento, la singularidad que se genera, siempre estará bajo los límites de la unidimensionalidad operacional de la máquina, es decir, la máquina aun no puede establecer métodos de pensamiento abductivos y trasductivos que son de naturaleza humana, y comportan relaciones mas allá de lo programable algoritmicamente.

Gracias.

Deja un comentario