Alumnos en un aula escolar, 1931 | Wikipedia | Dominio público

Cada vez más, un porcentaje de nuestras decisiones está influido o directamente determinado por algoritmos y medios informáticos. Aunque los resultados nos sean presentados como objetivos e independientes, es habitual que estas tecnologías sean opacas y no nos permitan contrastar las operaciones que hacen. Desde Taller Estampa proponen proyectos que nos ayuden a reapropiarnos de estas herramientas a partir de un análisis reflexivo y usando sus propios métodos matemáticos.

En los últimos años asistimos a un goteo de noticias sobre inteligencia artificial, aprendizaje maquínico y visión artificial. Se nos dice que las máquinas aprenden, ven, crean… Y todo esto construye un discurso basado en la novedad, en un futuro posible y en una serie de angustias y esperanzas. Es difícil, a veces, distinguir en este paisaje qué son desarrollos reales y qué son fantasías o advertencias. Y, sin lugar a dudas, esta niebla que lo rodea todo forma parte del poder que otorgamos, en presente y a crédito, a dichas herramientas, igual que forma parte, también, de las inquietudes negativas y positivas que nos despiertan. Muchos de estos discursos pueden caer en el campo de los falsos debates o, como mínimo, del retorno de viejos debates; así, en el terreno artístico clásico, asociado al discurso sobre la creación y la autoría, se discute la entidad que debe darse a las imágenes creadas con estas herramientas. (Pero el argumento en contra de la fotografía en el arte, ¿no era que se trataba de una imagen creada automáticamente y sin participación humana? ¿Y esto no era, también, el argumento a favor de tomarla y usarla para poner fin a una cierta idea del arte?)

Las metáforas son esenciales en el discurso sobre todas las herramientas digitales y en el poder que tienen. Expresiones como «inteligencia», «visión», «aprendizaje», «neuronal» y toda una fila de palabras similares, ¿son las más adecuadas para definir estas herramientas? Quizás no, sobretodo si se obvia su carácter metafórico. No las entenderíamos igual si las designásemos como herramientas de clasificación probabilística o si, en lugar de decir que una inteligencia artificial «ha pintado» un Rembrandt, dijésemos que ha hecho una reproducción estadística de su estilo (cosa que no deja de ser sorprendente y digno de celebración, claro está). Para estas herramientas, este tipo de denominaciones construyen una entidad que les dota de una supuesta autonomía e independencia, y en esto se basa su futura autoridad.

Porque en muchos casos se trata de esto: de construir una caracterización que legitime una capacidad objetiva o no humana en el análisis de los datos. O sea, un viejo juego de prestidigitación del poder en el que las cosas escapan a nuestro alcance, e incluso –y esto ya es cinismo, y no magia– al suyo, para encarnarse en supuestas operaciones objetivas e independientes. El ejemplo clásico en el contexto anglosajón es el uso que se puede hacer de ellas, por ejemplo, para el cálculo del coste de un seguro médico. Aquí, mientras no llegue también esta medida neoliberal presentada como lo que nos conviene –porque queremos ser una smart city, o la siguiente cosa que nos digan que queremos ser–, entendemos perfectamente la situación, que se plantea como un escenario en el que no hay ningún diálogo o discusión posible, más allá de la imposición del resultado del análisis de la red. Como en tantos y tantos casos, quizás esto no sea sino hacer evidente lo que ya pasa: si este gasto lo calcula un trabajador de la empresa, dudamos que sea muy dialogante, o que responda a unos criterios que nos quiera contar y que acepte que sean cuestionados. Pero da lo mismo si se hace mediante fórmulas que aplican los trabajadores o si es el output de una red neuronal fruto de los datos de la empresa de seguros y los datos de quien solicita el seguro: en ambos casos es así porque alguien ha aceptado que este método funciona, y es aquí donde hay una responsabilidad que solo es opaca porque se quiere que así sea –es decir, el funcionamiento interno de la red puede ser opaco, pero la decisión de usar una y la forma como se entrena no deberían serlo. La opacidad no es la característica principal de la inteligencia artificial, sino el carácter del poder.

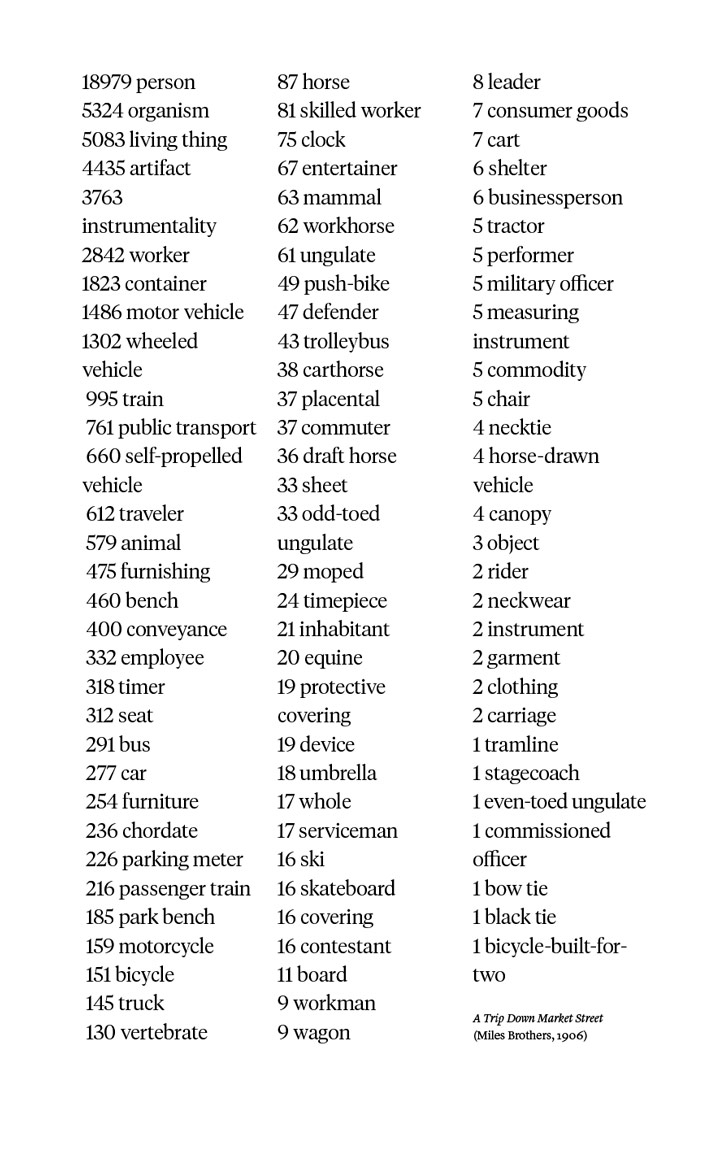

Si las metáforas son uno de los campos de poder de estas herramientas, tampoco debemos en ningún caso olvidar cuál es el contexto normativo en el que se desarrollan. Son unas herramientas que se crean dentro de la ideología de los datos masivos, y la celebran de lleno. Con esto nos referimos a la idea de que todo tiene que dejar rastro y debe ser archivado de manera automática y que, como se deduce de la expresión «minería de datos», los datos se plantean como un recurso natural disponible para la explotación. Esta metáfora es significativa como expresión de una fantasía capitalista: los datos serían un recurso natural que, al contrario de los que ya se han exprimido, no se agotaría, sino que, en un delirio propio de la fantasía, no haría más que incrementarse a medida que aceptamos gustosamente convivir y adquirir más y más aparatos que nos monitorizan. Es como si el sistema se hubiese construido su propio pozo sin fondo de cuento de hadas. Así, uno de los usos de las herramientas de visión artificial de detección de objetos no es otro que la anotación automática de imágenes; de manera que ya no solo sea la información textual la que sea susceptible de ser monitorizada automáticamente, sino también la visual, hasta el momento paradoxalmente opaca más allá de nuestros ojos.

Lista de detecciones realizadas con YOLO9000 en la película A Trip Down Market Street (1906) | El mal alumno – Estampa

Estamos ahora en el que es, probablemente, el momento de la primera recepción cultural de estas herramientas. De su desarrollo en campos de investigación, y de las aplicaciones que ya se han derivado de ellas, pasamos ahora a su presencia en el discurso público. Es en esta situación y en este contexto, en el que no sabemos del todo la amplitud y las características de estas tecnologías (y en el que, por lo tanto, los miedos son más abstractos y difusos y, pues, más presentes y poderosos), cuando es especialmente importante entender de qué hablamos, apropiarse de las herramientas e intervenir en los discursos. Antes de que sus posibilidades se restrinjan y se solidifiquen hasta parecer incontestables, debemos experimentar con ellas y reflexionar acerca de ellas; debemos aprovechar que todavía las podemos percibir fácilmente como si estuvieran en creación, maleables y abiertas.

En nuestros proyectos El mal alumno. Pedagogía crítica para inteligencias artificiales y Espacios latentes. Imaginaciones maquínicas hemos querido acercarnos a estas herramientas y a su imaginario. En la declaración de intenciones del primero expresábamos nuestro deseo de, frente al contexto normativo y la metáfora del aprendizaje maquínico, reivindicar el mal alumno como aquel que rehúye la norma. Y también expresábamos que, frente a una inteligencia artificial que busca replicar la humana a escalas inhumanas, debemos reivindicar y construir una no mimética que produzca relaciones e imágenes inesperadas.

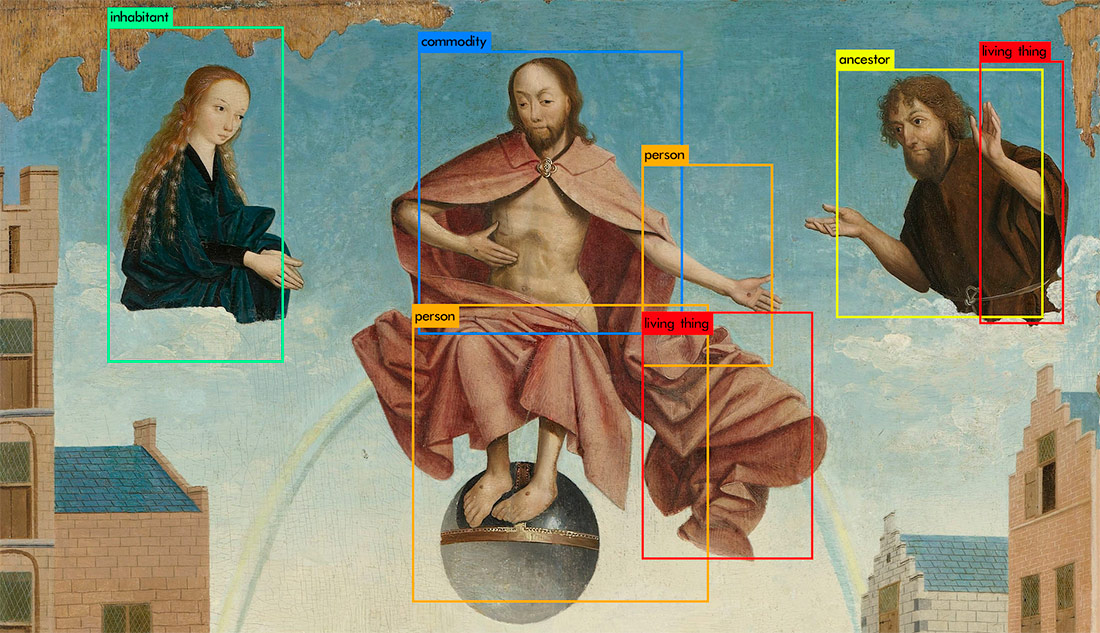

Fragmento de De zeven werken van barmhartigheid, Meester van Alkmaar, 1504 (Rijksmuseum, Amsterdam) analizado con YOLO9000 | El mal alumno – Estampa

Ambos proyectos son también intentos de apropiarse de estas herramientas, hecho que conlleva, en primer lugar, rehuir las barreras industriales y sus estándares. En este campo en el que los datos masivos son un bien al alcance de grandes empresas, utilizar conjuntos de datos cuantitativamente pobres y potencias de cálculo no industriales es, no solo una necesidad, sino sobretodo una reivindicación.

Entre las estrategias que guían nuestra práctica, una de las principales es la reflexiva. Utilizamos las herramientas de inteligencia artificial para dirigir la atención hacia ellas y fijarnos en sus procesos. Cuando se nos dice que una red de visión artificial «ve», se obvia que ve aquello que se le ha entrenado a ver. Es decir, el vocabulario de la red es básico para que vea y hable, y esta elección es de quien construye la red. Hacer evidente este eslabón de la cadena fue uno de nuestros objetivos, ya fuese fisgoneando vocabularios de herramientas o conjuntos de datos existentes (si queréis saber qué pinta tiene un «wagneriano», id a ImageNet y, cuando os hayáis hartado de reír, fijaos también que han hecho lo mismo para la categoría de «mala persona») o con varios détournements, en los que hemos substituido el vocabulario original por otros vocabularios que reflexionan sobre las mismas taxonomías (por ejemplo, la célebre clasificación imaginada por Borges de una enciclopedia china).

Si de las redes neuronales se nos dice que son expertas en aquello que hacen, no es menos cierto que, si lo son, lo son de forma compulsiva, ya que no saben hacer nada más. Esta compulsión es una excelente herramienta para multiplicar clasificaciones y relaciones hasta el paroxismo. Así, una red entrenada en estilos artísticos lo ve todo y se refiere a todo según este vocabulario, y otra entrenada para reconocer Cindy Sherman o Joan Fontcuberta no hace más que multiplicar su presencia por todos lados.

En nuestro último proyecto, Espacios latentes. Imaginaciones maquínicas, nos hemos centrado en el campo de la generación de imágenes mediante redes generativas adversarias o GAN (su acrónimo en inglés). Es decir, en la capacidad de estas redes de producir imágenes similares a los corpus de ejemplos que les proporcionamos. Este campo se enfoca habitualmente hacia una tendencia fotorealista, pero una práctica y una estética pobres de estas herramientas (con conjuntos de datos cuantitativamente inferiores a los industriales y con menos potencias de cálculo) nos lleva a otros imaginarios y texturas visuales. También aquí hemos querido aprovechar estrategias que nos parecen inherentes a la herramienta, como la del exceso, ya sea aplicada a la ilustración científica (un mundo altamente codificado, en el que cada imagen tiene que ser significativa), ya sea para investigar imaginarios contemporáneos (por ejemplo, construyendo un conjunto de datos de ejemplos asociados a La Gioconda, es decir, a una imagen mil veces versionada e icónica del arte y el turismo). Las propias metáforas tecnológicas también pasan a un primer plano. Así, por ejemplo, la denominación «espacio latente» hace referencia a la manera como se concibe una red GAN una vez entrenada: se entiende como un sistema de coordenadas multidimensional que podríamos explorar y en el que cada imagen que puede generar se corresponde con un punto de este sistema. Por este motivo, en varios experimentos hemos trabajado la opción de desdoblar un espacio real en un espacio virtual, como, por ejemplo, los pasillos de The Shinning.

Lo que nos mueve en estos proyectos es comprender y usar estas herramientas como una estrategia básica para huir de la mistificación que las envuelve. Obviar las barreras de discurso y industriales que nos las alejan y nos las ofrecen ya predeterminadas. También tenemos que poder reírnos de ellas y usarlas a contrapelo, o sea, tenerlas a nuestro alcance y no a la inversa.

Deja un comentario