Sharon Hogge, enginyera electrònica, amb robot de sentinella autònom ROBART I i el robot industrial HT3. Maryland, 1983 | The U.S. National Archives | Domini públic

La tecnologia ens envolta i és per tot arreu, però com es fa, aquesta tecnologia, i qui se’n beneficia realment i qui no, encara són qüestions importants que cal investigar. Darrerament sorgeixen moviments com el Data Feminism o la Design Justice, que analitzen la tecnologia des d’una òptica mes crítica amb la intenció de crear més equitat en la pràctica tecnològica. N’explorem algunes implicacions a partir del projecte artístic Feminist Data Set, guiats per la seva creadora, que explora com seria un sistema feminista interseccional d’aprenentatge automàtic (machine learning) i d’etiquetatge i de dades d’entrenament (data training), i què caldria per construir-lo.

En temps de ressorgiment del feixisme i d’una aparent pèrdua dels valors de justícia social, i en l’era de la digitalització global, la justícia social és més important que mai a l’hora de qüestionar les dades, la tecnologia i l’estructura de la societat com a tal. Estem absolutament envoltats de tecnologia, però ¿com es fabrica la tecnologia i qui se’n beneficia profundament, i qui no? Són preguntes importants que encara no hem respost i que cal indagar i analitzar. Feminist Data Set és un projecte artístic que posa el feminisme interseccional com a punt de partida per investigar i qüestionar l’aprenentatge automàtic. És una recerca feta des del punt de vista del disseny crític, ja que el projecte consisteix a crear un bot conversacional des de zero a partir de les premisses del feminisme interseccional, la qual cosa fa que sorgeixin preguntes com: des del punt de vista del feminisme interseccional, què vol dir recopilar dades?, i com són aquestes dades i com s’etiqueten? i què són les dades d’entrenament?, ¿existeix un sistema o producte feminista interseccional per etiquetar-ne les dades o obtenir-ne dades d’entrenament?, ¿quin aspecte té el programari feminista interseccional, i què fa? ¿existeixen algoritmes en clau de feminisme interseccional?, o què necessitarien per existir?, com seria un bot conversacional interseccional i com interaccionaria?

Políticament i artísticament, Feminist Data Set s’inspira en la cultura maker, el disseny crític, l’Arte Útil, el Data Feminism, la Design Justice, el Critical Engineering Manifesto, el Xenofeminisme i els Principis feministes d’Internet. Pedagògicament, Feminist Data Set se situa en la línia de treballs com The Toaster Project de Thomas Thwaites, una obra de disseny crític que consistia a fabricar una torradora domèstica des de zero. Feminist Data Set aporta una mirada crítica i artística al programari, especialment pel que fa a l’aprenentatge automàtic. Què vol dir crear un aprenentatge automàtic de manera conscient i tenir en consideració, amb tota la cura possible, cada aspecte possible del procés de crear, reproduir i dissenyar? Caldria revisar a consciència cada part d’aquest procés des d’una perspectiva feminista.

Hi ha una tendència a l’alça a analitzar la tecnologia des d’un punt de vista crític i ètic, tot i que en els últims temps, «ètic» és una paraula que crea certa controvèrsia i de la qual s’abusa. Però aquesta visió crítica és important, sobretot perquè aporta més equitat a la tecnologia com a pràctica i com a entitat per si mateixa –en el sentit que la tecnologia és un tipus de cosa determinada, ja sigui programari o maquinari, i la pràctica seria la manera com un individu o un grup utilitzen la tecnologia per contribuir als seus processos creatius i productius. Llibres recents com Data Feminism, de Catherine D’Ignazio i Lauren Klein, generen una pràctica que analitza dades i conjunts de dades de la societat i crea metodologies per tal de fer un millor ús de les dades des d’una perspectiva feminista. Design Justice, de Sasha Costanza-Chock, situa la justícia social directament en el món del disseny, en l’elaboració, la producció i la planificació del disseny com a exercici i pràctica.

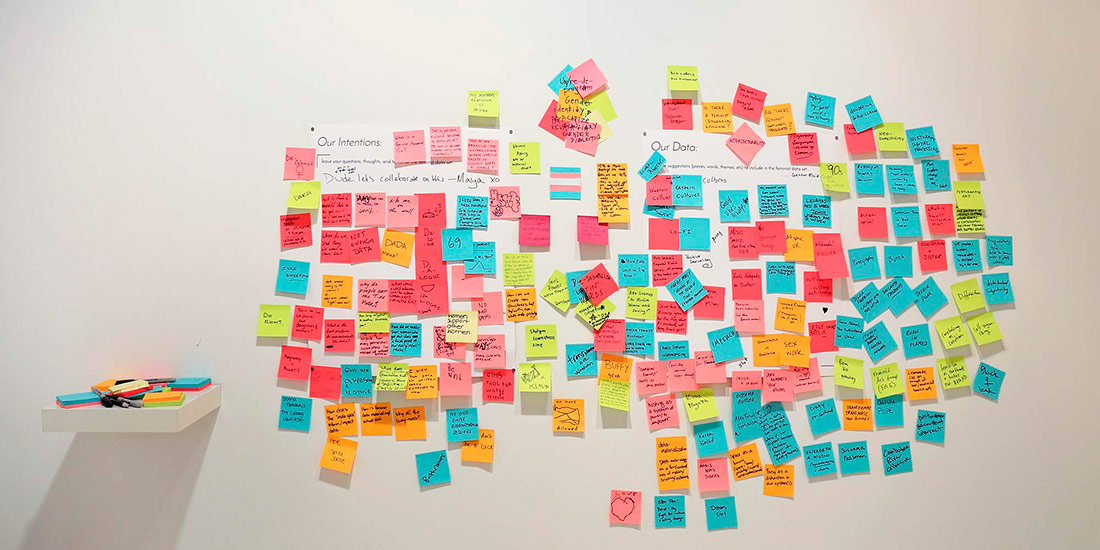

Feminist Data Set | Caroline Sinders

Tant a Data Feminism com a Design Justice es parla de com les estructures capitalistes i empresarials utilitzen el disseny i les dades, i de com els tecnòlegs amb consciència cívica, els moviments de justícia social i els activistes s’involucren en temes relacionats amb les dades i el disseny. Tots dos llibres parlen de disseny i dades tant en contextos empresarials com no empresarials, i amb això aconsegueixen una visió més holística i expansiva de l’ús de les dades i el disseny, que va de l’extrem més problemàtic –l’empresarial– al més just –el de la justícia social i l’activisme. Sens dubte cal explorar no només aquests dos extrems de l’espectre, sinó també tots els espais intermedis, i això és el que fa que Data Feminism i Design Justice siguin molt potents com a llibres, metodologies i casos d’ús. Feminist Data Set parteix d’un posicionament similar. Qüestiona l’aprenentatge automàtic d’una manera que va més enllà de l’exercici artístic i s’endinsa en el món del disseny de producte i el món empresarial i constata que la tecnologia interpreta de manera incorrecta el concepte de l’aprenentatge automàtic i que després no en fa un bon ús en cada cas particular de les peces que conformen l’entramat d’aquest sistema.

Moltes vegades, les eines que necessito per fer que Feminist Data Set sigui un projecte crític i artístic no existeixen. Per exemple, què és una plataforma feminista de dades d’entrenament? N’existeix cap? En l’aprenentatge automàtic, quan es tracta d’etiquetar dades i crear models de dades per a construir algoritmes, es recorre al Mechanical Turk, la mà d’obra d’Amazon, per fer aquesta tasca. Amazon va crear Mechanical Turk per solucionar el seu problema particular d’aprenentatge automàtic: necessitaven entrenar i etiquetar grans conjunts de dades. És habitual fer servir el Mechanical Turk en projectes d’aprenentatge automàtic i es fa servir en totes les àrees per etiquetar dades: des d’empreses de tecnologia fins a grups de recerca. Mechanical Turk paga precàriament als seus treballadors i els considera empleats temporals en comptes de treballadors a temps complet, la qual cosa fa que encara tinguin menys ingressos, i això no és un tema específic del feminisme interseccional, o sigui que no ho puc fer servir per al meu projecte… He de buscar una alternativa, o bé construir-ne una. Durant l’últim any m’he dedicat a investigar com seria un sistema feminista interseccional d’aprenentatge automàtic i d’etiquetatge i de dades d’entrenament, i què es necessitaria per materialitzar-lo. He creat una eina, similar a una calculadora, que tradueix el nombre de tasques que realitza un Turker, i el cost d’aquestes tasques, en el sou per hora. Per exemple, un client estipula deu mil tasques a quatre cèntims cada una: la calculadora ho traduiria a les hores o dies de feina que trigaria un Turker a fer totes aquestes tasques, i quin seria el seu salari.

En aquest sentit, a Feminist Data Set l’art es barreja amb la investigació i la tecnologia impulsades per l’ànsia de justícia social, com Turkopticon, elaborat per la Professora Lilly Irani i Mechanical Turkers. Turkopticon permet a Mechanical Turkers valorar les feines i els clients. Aquesta millora posa fi a un problema real amb què es troben els treballadors, que sovint no saben com és el client en qüestió i no tenen cap manera de compartir la informació amb altres Turkers.

Ordenació de dades feministes recollides al SOHO20, 2018 | SOHO20 Gallery / Rachel Steinberg

Per tal de crear una intel·ligència artificial feminista, cal dinamitar la desigualtat salarial i d’hores de feina en els sistemes d’aprenentatge automàtic amb dades d’entrenament. En un article a The Atlantic que investiga el tracte que donen a Mechanical Turkers, s’afirma que el problema «no és necessàriament que els sol·licitants paguen per sota del salari mínim. El sol·licitant paga una mitjana d’uns 11 dòlars l’hora pels serveis obtinguts», segons Hara, «però també n’hi ha molts que paguen menys, i n’hi ha molts d’altres que publiquen tasques que es triguen més a fer del que ells diuen. Tot i això, el veritable problema és que aquestes plataformes permeten que els sol·licitants s’estalviïn de pagar als treballadors els períodes d’inactivitat que existirien si estiguessin contractats a temps complet».

En un article d’investigació, coescrit per Kristy Milland, investigadora i Mechanical Turker, es va publicar que el salari mitjà era d’uns dos dòlars l’hora, però que només el 4% dels Turkers guanyaven més de 7,25 dòlars l’hora.

Què seria una versió feminista de Mechanical Turk? Què necessitaria?

Per arribar a la igualtat en la tecnologia i la societat primer cal aconseguir la igualtat salarial i la paritat salarial. Els treballadors haurien de cobrar pel seu temps, no només pel temps que han dedicat a fer una tasca concreta, sinó pel temps que han dedicat a buscar feina i a organitzar-se les diferents tasques del projecte, i haurien de cobrar dignament. Les empreses que fomenten l’«economia de bolos» haurien de complir el que diu la legislació laboral vigent.

Això s’ha de fer conscientment i amb esperit crític, si volem aconseguir la igualtat. Ha de poder rebre valoracions i interpretacions diverses. Hem de tenir clara la funció de la creació de dades i tenir present que els sistemes poden fer ús o abús de les dades, o beneficiar-se’n. Les dades s’han d’entendre com un producte que ha sorgit de la comunitat, que la representa, i qui és el propietari d’aquestes dades és un factor clau. El lloc on se situen les dades en els sistemes tecnològics és una qüestió política, activa, íntima. Per tal d’aconseguir la igualtat en l’aprenentatge automàtic, cal analitzar cada aspecte del sistema, disseccionar-lo i tornar-lo a construir; cal integrar-hi les realitats, contextos i limitacions de tots els tipus de persones que existeixen, no només d’aquelles que van construir la primera web. La tecnologia ha de representar tota la gent que forma part de la xarxa actualment.

Deixa un comentari